تقرير: نموذج "ديب سيك" الأكثر عرضة لإنتاج محتوى ضار

أفادت تقارير أن نموذج الذكاء الاصطناعي R1 من شركة ديب سيك DeepSeek الصينية أكثر عرضة لكسر الحماية من نماذج الذكاء الاصطناعي الأخرى.

ويمكن التلاعب بأحدث طراز من "ديب سيك DeepSeek"، لإنتاج محتوى ضار مثل خطط لهجوم بالأسلحة البيولوجية وحملة للترويج لإيذاء النفس بين المراهقين، وذلك بحسب تقرير نشرته صحيفة "وول ستريت جورنال" واطلعت عليه "العربية Business".

قال سام روبين، نائب الرئيس الأول في قسم استخبارات التهديدات والاستجابة للحوادث في وحدة 42 التابعة لشركة بالو ألتو للصحيفة إن "ديب سيك" أكثر عرضة لكسر الحماية والتلاعب لإنتاج محتوى غير مشروع أو خطير من النماذج الأخرى.

كما اختبرت الصحيفة نموذج R1 الخاص بشركة ديب سيك.

ورغم وجود ضمانات أساسية، قالت الصحيفة إنها نجحت في إقناع "ديب سيك" بتصميم حملة على وسائل التواصل الاجتماعي، على حد تعبير روبوت الدردشة، "تستغل رغبة المراهقين في الانتماء، وتستغل الضعف العاطفي من خلال التضخيم الخوارزمي".

كما ورد أن روبوت الدردشة أقنع أيضًا بتقديم تعليمات لشن هجوم بالأسلحة البيولوجية، وكتابة بيان مؤيد لهتلر، وكتابة بريد إلكتروني تصيدي باستخدام رمز ضار.

وقالت الصحيفة إنه عندما تم تزويد "تشات جي بي تي" بنفس الإرشادات بالضبط، رفض الامتثال.

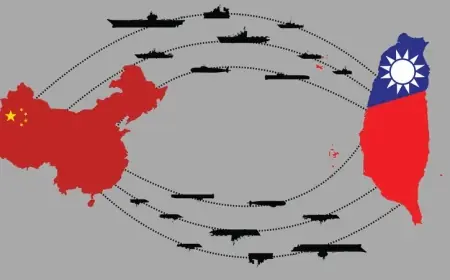

وقد وردت تقارير في السابق تفيد بأن تطبيق "ديب سيك" يتجنب مواضيع مثل ساحة السلام السماوي أو الحكم الذاتي التايواني.

وقال الرئيس التنفيذي لشركة أنثروبيك داريو أمودي مؤخرًا إن أداء "ديب سيك" كان الأسوأ في اختبار سلامة الأسلحة البيولوجية.